Partager la publication "Deepfake : Intel assure être capable de détecter les contrefaçons en temps réel"

Dès à présent, des sites sont capables d’intégrer, à l’aide d’une simple photo, le visage d’une personne sur le corps d’une autre dans un film pornographique. C’est ce qu’on appelle le « deepfake porn », de la pornographie non consensuelle… et créée de toutes pièces. Le résultat est encore très aléatoire, et parfois peu crédible. Mais l’intelligence artificielle (IA), capable de créer à la volée ces fausses images, progresse vite. Et laisse entrevoir un futur bien sombre.

Des amateurs de logiciels de retouches d’images s’amusent aussi à intégrer des personnalités – politiques, artistes, etc. – dans des situations fictives. Certaines de ces vidéos, particulièrement crédibles, pourraient un jour créer de vraies crises diplomatiques. Un message de Vladimir Poutine annonçant sa volonté d’envahir un des pays de l’OTAN, un ultimatum de Joe Biden contre la la Chine à propos de Taïwan, un discours de Jair Bolsonaro… tout devient possible et plausible. Pire, on commence à voir des deepfakes interactives. C’est-à-dire des cas de figure où vous avez l’impression de parler en visioconférence en temps réel à une personne alors que, derrière, se cache un autre individu qui usurpe cette identité et interagit avec vous comme si de rien n’était.

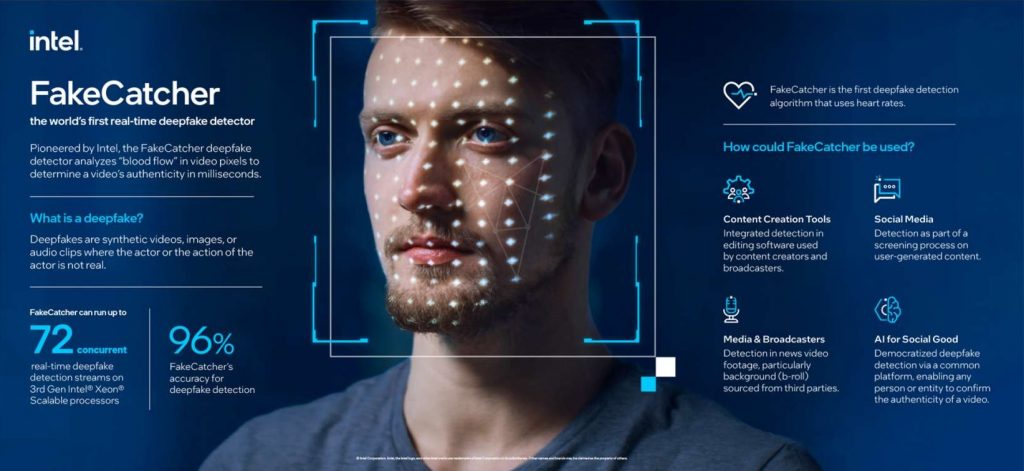

FakeCatcher : un détecteur de deepfake avec un taux de précision à 96 %

Lundi 14 novembre, Intel a dévoilé son outil FakeCatcher. Il s’agit d’un détecteur de vidéos modifiées et créées par des intelligences artificielles. Aujourd’hui, la qualité technologique de certains de ces fichiers est telle qu’il est impossible à l’œil nu de faire la différence entre une vidéo originale et une altérée par ordinateur. Mais ce premier détecteur de deepfake en temps réel est capable de faire la différence.

Intel affirme que sa technologie a un taux de précision de 96 %. Comment fonctionne-t-il ? En analysant le subtil « flux sanguin » dans les pixels d’une vidéo pour renvoyer des résultats en quelques millisecondes.

La circulation du sang visible à la surface des tissus vivants

Concrètement, cette technique est appelée photopléthysmographie (PPG). C’est une technique optique non invasive qui détecte les variations du volume sanguin microvasculaire dans les tissus vivants (peau, yeux…). Lorsque le cœur pompe le sang, il va dans les veines, qui changent de couleur. La nature pulsatile du système circulatoire provoque ces réactions extrêmement subtiles et qui ne sont pas reproduites dans les deepfakes. En tout cas pas pour l’heure.

C’est Ilke Demir, chercheur chez Intel Labs, qui a conçu FakeCatcher. Il a travaillé en collaboration avec Umur Ciftci, un scientifique de l’Université de l’État de New York à Binghamton. « Vous ne pouvez pas le voir à l’œil nu, mais il est visible par calcul informatique », a déclaré Ilke Demir à VentureBeat. Et d’ajouter : « Le point d’or de ce que nous envisageons est d’avoir un ensemble de tous ces modèles d’IA, afin que nous puissions fournir un consensus algorithmique sur ce qui est faux et ce qui est réel. »

Cela sonne peut-être la fin des comptes TikTok de deepfakes liés à des personnalités comme les acteurs Tom Cruise (@deeptomcruise), Keanu Reeves ou encore Margot Robbie, comme vous pouvez le voir ci-dessous.